Chez La FabSonic, tout tourne autour de l’immersif. Installé depuis début 2022 dans les locaux de TREMPO à Nantes, ce studio spécialisé dans les projets spatialisés à géométrie variable, est animé par Jérôme Boudeau, Christophe Sartori et Florian Chauvet.

Le son fait partie de leurs vies, de leur travail depuis toujours. Ils maîtrisent toutes les étapes d’un spectacle, d’un événement ou d’une production utilisant du son immersif. De la création d’un contenu sonore à sa diffusion finale sous toutes ses formes, La FabSonic a les compétences requises et l’outil de création, de recherche et de modélisation.

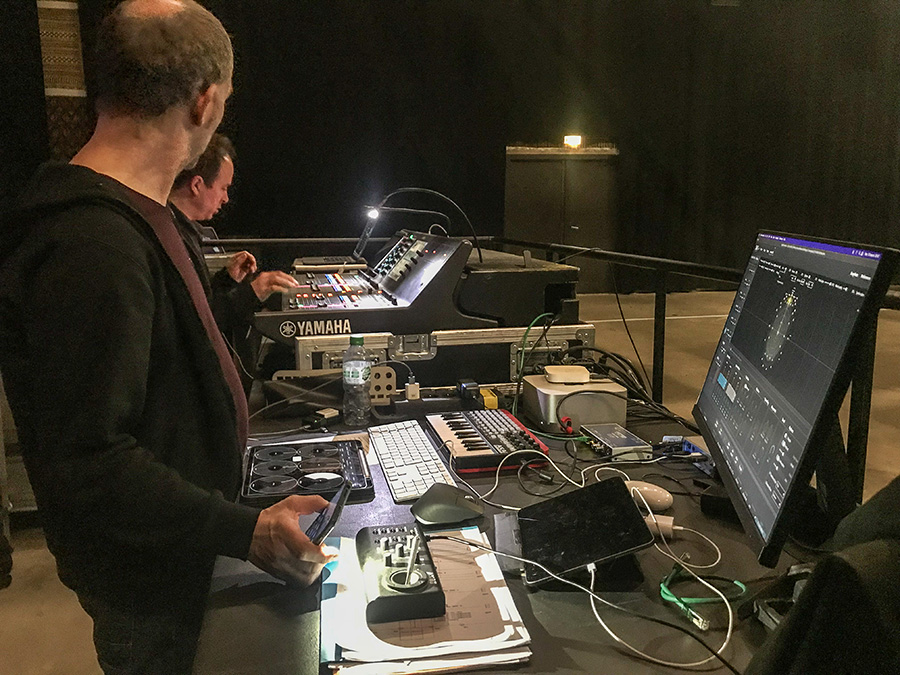

C’est dans ce véritable studio immersif que Florian Chauvet et Jérôme Boudeau nous accueillent pour un entretien passionné sur la nouvelle place de la spatialisation dans l’ensemble des disciplines audio, et sur la polyvalence apportée par le logiciel SPAT Revolution de Flux, qu’ils ont choisi comme moteur principal de l’immersif.

SLU : Comment est née l’équipe et le studio La FabSonic ?

Florian Chauvet : Le studio a été créé à la base comme un outil de travail. Il n’est pas dédié à la prestation même. C’est plutôt un laboratoire pour nous trois : Jérôme Boudeau, régisseur son spectacles et tournées, Christophe Sartori, compositeur et régisseur son pour la danse, le théâtre et la radio, et moi-même Florian Chauvet, ingénieur du son musique. Nous sommes aussi tous formateurs aux lycée Gabriel Guist’hau pour le DN MADE Spectacle.

C’est comme ça que nous nous sommes tous retrouvés à Nantes. Au cours d’une réunion de travail nous avons évoqué l’immersif et notre collaboration commençait. Nous avons pu obtenir ce lieu à la suite d’un appel à projet au sein de l’espace d’émergences musicales TREMPO et nous l’avons équipé pour nous permettre de travailler le son immersif sous tous ces aspects.

SLU : Votre structure se concentre sur la démocratisation du son spatialisé ?

Florian Chauvet : Oui on peut le voir comme ça ; nous utilisons nos réseaux de connaissances professionnelles pour faire passer notre message que maintenant, on peut faire autrement que la simple stéréo.

SLU : Pourquoi faire de l’immersif ?

Florian Chauvet : Pour les sensations que le son immersif nous apporte. Nous sommes partis du constat que dans le spectacle nous mixons en double mono depuis trente ans, car on mixe en stéréo seulement pour 8% de la salle environ.

Et nous avons aujourd’hui la possibilité de faire découvrir le même son à tout l’auditoire, ce qui est quand même une véritable révolution. Cela génère un plaisir renforcé d’écouter de la musique. Nous distinguons dans cette approche le son spatialisé, qui est frontal, et l’immersif à partir du moment où on fait du 360° autour du public.

SLU : Quel type de productions gérez-vous ?

Florian Chauvet : Notre cœur de métier, c’est le spectacle vivant pour la musique, le théâtre et la danse. Aussi la scénographie sonore pour la muséographie dans laquelle il y a un fort intérêt pour l’immersif. Cela nous intéresse beaucoup car il n’y a plus forcément la relation avec le visuel, ce qui ouvre encore plus de possibilités créatives.

SLU : Quels sont vos interlocuteurs ?

Florian Chauvet : Ce sont les artistes, les chorégraphes, les metteurs en scène, les scénographes. Nous pouvons ainsi rédiger un cahier des charges qui permet de réaliser le spectacle immersif de la création à la diffusion. Nous ne sommes pas ici pour promouvoir du matériel. Nous sommes là pour donner la solution adaptée à tout type de spectacle.

Nous essayons toujours d’optimiser le workflow entre la demande et le résultat, pour une cohérence financière et artistique, afin que l’expérience immersive fonctionne et réussisse.

SLU : Est-ce que les technologies de diffusion sont prêtes pour l’immersif ?

Florian Chauvet : Pour le live, oui car la diffusion spatialisée ou immersive est déjà exploitée. Pour le grand public c’est plus compliqué. La meilleure écoute pour l’instant me parait le casque avec le binaural. De nouvelles barres de son ou systèmes d’enceintes apparaissent pour la maison, mais faut-il encore avoir des espaces adaptés.

En tout cas, pour le live, nous avons déjà un très grand choix de solutions techniques offertes par de nombreux fabricants.

SLU : Vous poussez l’immersif ou la demande est déjà forte ?

Florian Chauvet : La demande est en train d’arriver. Nous sommes précurseurs avec notre studio dédié à la création pour le spectacle vivant. Il y a de l’intérêt de la part des artistes et des salles. Comme on sait que ces dernières renouvellent leur équipement tous les 10 à 15 ans, nous leurs portons le message que si un jour on change la diffusion, il est possible de faire autrement avec du spatialisé.

Nous jouons notre rôle de conseil et de prescription. On peut proposer, si l’installation permanente n’est pas d’actualité, des rajouts ou par exemple des accroches pour anticiper et permettre le déploiement d’immersif occasionnel pour accueillir des spectacles qui, déjà maintenant, le demandent dans leur fiche technique.

Jérôme Boudeau : En un peu plus d’un an nous avons fait beaucoup de démos auprès des artistes, des compagnies de théâtres et de danse et ils repartent avec beaucoup d’envies. Ils ont les oreilles qui brillent. Il leur faut un peu de temps pour appréhender cette nouvelle technique et l’intégrer dans leur démarche artistique. Ils ont beaucoup de questions et nous les accompagnons aussi sur ce sujet.

SLU : Et au niveau des installations fixes dans les salles ?

Florian Chauvet : Sur ce point, nous avons déjà une forte demande des acousticiens. Avec les nouvelles normes sur les émergences, ils ont bien compris que l’immersif était une des solutions pour résoudre ou atténuer certains soucis acoustiques. Quand les artistes commenceront à penser l’immersif en élargissant l’espace sonore, ce sera encore plus compliqué de comprendre où l’on mesure la pression. Mais c’est beaucoup plus agréable pour les oreilles. Et la sensation physique est là, sans forcément avoir envie de pousser davantage la pression.

SLU : L’expérience d’écoute en est bien plus agréable ?

Jérôme Boudeau : L’immersif ne fait pas forcément l’effet Waouh ! L’énorme avantage c’est surtout d’être naturel. Cela ne doit pas faire Waouh d’ailleurs. Le système d’enceintes devient transparent pour produire le même son partout, le vrai son de l’artiste.

Florian Chauvet : Beaucoup de personnes s’attendent à de l’extraordinaire. Et ce qui l’est, c’est d’entendre partout dans la salle, la même balance sonore et une spatialisation en raccord avec le visuel. Partout dans la salle le public entend ton mix et c’est une véritable révolution.

SLU : Pour ça, il faut un algorithme de spatialisation temporel de type WFS ?

Florian Chauvet : Oui, un algorithme temporel de type WFS est idéal pour ça. Pour simplifier, chaque objet sonore est envoyé dans toutes les enceintes avec un niveau et un délai en fonction de sa position. Donc si un instrument est sur scène à gauche, l’auditeur l’entend plus fort et en premier temporellement dans les enceintes à sa gauche et son cerveau le replace parfaitement à gauche. Ce qui permet d’entendre les objets sonores toujours à la même position visuelles qu’importe où on se trouve dans la salle. Ceci donne une diffusion extrêmement naturelle.

Jérôme Boudeau : Le principe de la WFS n’était pas conçu pour ce que l’on fait aujourd’hui dans notre spécialité. L’idée originale était de créer une source sonore fantôme au milieu des enceintes. Recréer une seule enceinte composée de multiples unités qui faisaient le tour de la pièce. Avec nos systèmes actuels qui sont une déclinaison de la WFS, on ne peut bien sûr pas faire ça. Le son vient toujours de derrière les enceintes.

Cette technique s’appuie sur une théorie développée par le physicien Huygens à la fin du XVII° siècle. La puissance des calculateurs de maintenant nous permet de pouvoir utiliser cette théorie avec beaucoup moins d’enceintes et donc de l’adapter au live. Mais il y a plein d’autres modes de spatialisation.

SLU : Donc la WFS, cela ne fonctionne pas pour tout et partout ?

Florian Chauvet : L’inconvénient de la WFS qui utilise des délais, c‘est de rendre audibles des mouvement rapides de sources. On entend obligatoirement des artefacts dus à l’adaptation des délais quand on déplace rapidement un objet sonore. Dans ce cas on utilise des algorithmes de spatialisation qui ne gèrent, c’est plus complexe que ça en réalité, que le paramètre d’amplitude.

SLU : Alors avec tous ces systèmes, comment dit-on ? Un système immersif, un système spatialisé ?

Florian Chauvet : Alors il a de la 2D, de la 3D, de l’immersif et de la spatialisation, il y a beaucoup de termes. On peut dire quand même spatialisé pour la mise en place d’objets sonores sur une image frontale comme la WFS, et l’immersif quand on recrée un espace multidirectionnel comme de la 2D en 360° et la 3D mais ce qui est rare pour l’instant dans une salle de spectacle. Personne n’est vraiment d’accord sur les termes à employer ! C’est notre interprétation.

Jérôme Boudeau : Dans la salle La Rampe à Grenoble il y a un système d’acoustique active Carmen dont nous avons pu récupérer l’accès à chacune des boîtes en séparé et nous avons pu créer un véritable système 17.6.1 avec un véritable plafond pour un spectacle musical totalement immersif.

SLU : Et je suppose que c’est là que le logiciel SPAT intervient ?

Florian Chauvet : Toutes ces variantes d’algorithmes et de systèmes nous amènent à parler du SPAT de Flux que nous utilisons sur l’ensemble de nos projets. Sa grande force c’est d’avoir la capacité de tout gérer. Il permet d’exploiter tous les types d’algorithmes de spatialisation, y compris la WFS et tous les modes de panoramique comme le VBAP. En tournée c’est un énorme avantage car il permet d’adapter la création aux nombreux systèmes de diffusion que nous pourrions être amenés à rencontrer.

Jérôme Boudeau : Dans les systèmes de diffusion spatialisée développés par les fabricants d’enceintes, comme L-Acoustics et d&b avec leurs L-ISA et Soundscape, il y a des paramètres directs sous la main. C’est bien entendu voulu car ça rassure l’ingé son qui ne maîtrise pas en profondeur la spatialisation. La grande force de ces systèmes c’est qu’ils apportent la prédiction.

Tout est simulé dans les logiciels qui permettent de concevoir les systèmes. Comment savoir si l’auditeur va, à cet endroit, avoir une bonne image sonore. C’est un avantage majeur qui permet de répondre à des cahiers des charges précis de sonorisation de salles. En revanche, c’est propriétaire et donc plus difficile à exploiter avec des variantes de systèmes de diffusion pour certains.

SLU : Mais alors est-ce possible d’utiliser SPAT en même temps qu’un système Soundcaspe ou L-ISA par exemple ?

Florian Chauvet : Oui bien sûr et c’est important. Par exemple, un artiste qui vient chez nous pour préparer une tournée, nous allons configurer le studio en positionnant un kit d’enceintes qui va simuler en échelle réduite par exemple un Zénith. Nous allons utiliser du VBAP ou de la WFS pour gérer sa spatialisation comme ce le sera pendant son concert.

Il pourra travailler ses automations et ses mouvements et l’avantage avec SPAT, c’est qu’une fois qu’on a fait tout ça, on peut modifier la distances des enceintes comme elles seront sur le lieu du spectacle, et le logiciel recalcule tout simplement.

Avec un système utilisant ses propres algorithmes comme L-ISA, on peut aussi utiliser le SPAT pour commander uniquement les mouvements des objets en envoyant les trajectoires des objets via le protocole ADM OSC à la matrice immersive choisie. L’ADM OSC est un protocole OSC unifié développé par plusieurs fabricants.

Jérôme Boudeau : Les calculs de SPAT sont basés sur des modèles sphériques. Donc peu importe la place du haut-parleur, SPAT est capable de recalculer immédiatement. Avec cet outil nous avons tous les paramètres sous la main avec une interface utilisateur basée sur l’artistique qui est utilisable de manière indépendante d’un système propriétaire.

Ceci n’exclut pas que nous puissions travailler avec Soundscape et L-ISA, mais aussi Space Hub de Coda, Fletcher Machine d’Adamson ou encore Holophonix d’Amadeus.

SLU : Les systèmes propriétaire ont donc aussi un grand rôle à jouer ?

Florian Chauvet : Oui. Quand on regarde les méthodes de diffusion en danse en en théâtre, c’était très courant de poser des enceintes un peu partout sur le plateau, à l’arrière, sur les gradins, pour simuler des choses et faire de la multidiffusion où on ne déplaçait pas le son mais où on le plaçait.

Avant c’étaient les créateurs qui géraient l’immersif avec de la multidiffusion. Pour eux, rien de nouveau. Ce qui devient intéressant c’est que cela vient des fabricants d’enceintes. Cela amène une normalisation et surtout propose un arrangement d’enceintes cohérents, qui amène du liant dans la matière sonore diffusée. Et en plus cela apporte une réverbération de pièces vraiment multicanale.

Jérôme Boudeau : Par exemple, au Quatrain près de Nantes où j’ai fait beaucoup d’accueil de spectacles de danse et théâtre, il m’est arrivé qu’on me demande de placer des X12 et X15 en mode indirect pour taper dans les murs et dans les plafonds, Ca fait mal au cœur de d’employer de telles enceintes dos au public pour reconstituer une réverbération. La modernité des systèmes de diffusion va nous aider.

SLU : Pourquoi un studio immersif ?

Florian Chauvet : En immersif, ce n’est pas le tout de se dire que ça peut marcher, il faut le pratiquer pour voir comment cela fonctionne et comment préparer les sons. Par exemple en WFS, il n’y a plus d’effet de masque. Donc le travail de mixage traditionnel qui consiste à traiter les différents objets pour les faire se différencier n’est plus nécessaire.

Maintenant c’est plus naturel, mais il faut toujours savoir faire du son. Cela peut être déroutant car ça crée des impressions très différentes qu’il faut apprendre à maîtriser. Une forme de rééducation peut être nécessaire.

SLU : Puisque vous maîtrisez l’immersif, est-ce que la prescription est l’une de vos missions?

Florian Chauvet : Oui et nous pouvons préconiser le système totalement adapté à un spectacle, une tournée ou une salle. Au centre culturel nantais Le Lieu Unique, nous avons fait une installation en 360°. On a même mis la façade derrière les musiciens. Cela fonctionnait très bien. Nous gérions le système de diffusion, la régie et l’accueil.

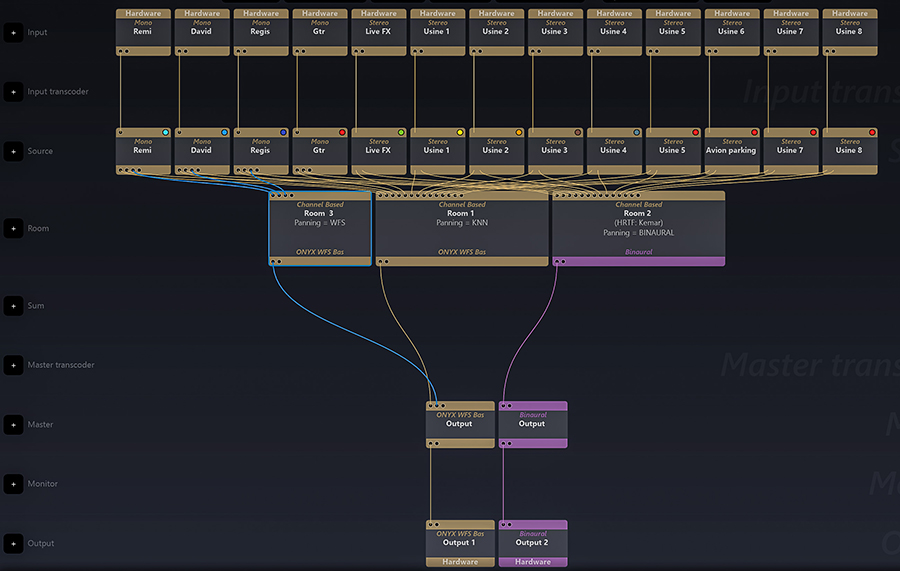

SLU : Dans une configuration comme ça, vous utilisez SPAT ?

Florian Chauvet : Oui bien sûr, nous reprenons les direct out post fader des instruments, comme ça on récupère tout ce que fait le mixeur. Nous entrons dans le SPAT pour traiter puis on ressort soit directement dans le système, soit dans la console et on utilise les sorties de cette dernière pour attaquer le système. L’avantage de tout faire revenir dans la table, c’est que le classique LR reste dans la configuration et l’ingé son peut l’enclencher quand il le désire.

Un des avantages de SPAT est de pouvoir gérer tout type de configuration de diffusion. On peut faire une vraie stéréo à l’ancienne qui part dans la console, et si on ne veut pas repasser par la console, on crée dans SPAT une room stéréo où les sons seront mixés comme dans une stéréo standard et on attaque directement le système. SPAT nous permet de répondre rapidement à toutes demandes de l’ingé et en accueil, c’est un des points les plus importants.

SLU : SPAT peut gérer plusieurs configurations immersives simultanément ?

Florian Chauvet : Oui, il peut avoir une Room stéréo, une Room WFS, une Room VBAP et l’on choisit pour chacune quels instruments vont dedans et pouvons générer un mixage binaural pour l’écoute casque. Tout dépend du nombre de sorties de l’interface audio utilisée et de la puissance du processeur de l’ordinateur. En live, nous utilisons généralement une carte RME DIGIFACE Dante.

SLU : Comment un artiste utilise-t-il votre studio ?

Jérôme Boudeau : L’idée est de proposer un outil qui permette à l’artiste de finaliser sa création immersive. Il peut dans son studio personnel utiliser un système pour mixer au casque en binaural. Le binaural est parfait pour commencer à élaborer sa création immersive mais il ne permet pas de tout bien entendre.

Pour finaliser, il vient au studio où l’on aura choisi un placement d’enceintes cohérent avec le projet. Si ensuite il doit diffuser sa création sur une autre configuration, par exemple en 8, dans le studio nous allons transcoder son mix au bon format avec SPAT sous forme d’un rendu multipiste dans Reaper.

SLU : Et quand tu utilises différents types de systèmes immersisf, le placement des objets restent identiques, cohérents entre les différents systèmes ?

Florian Chauvet : Dans SPAT, tu crées des Rooms, des espaces sonores qui peuvent être stéréo, binauraux, WFS, VBAP, etc… Ce sont des objets que l’on bouge. SPAT restitue ensuite l’objet la où il se trouve dans la room.

SLU : Et au niveau de la latence ?

Florian Chauvet : On est à 64 samples sur l’ordi, et avec les interfaces audio, les consoles et les process d’amplis, on se retrouve souvent vers 12 ms. La latence de nos jours est un point à scruter de très près, mais jusqu’à maintenant nous la gérons sans aucun souci en live. Les musiciens ont généralement leur système de retours et souvent des ears, ce qui ne leur pose donc pas de problème.

Jérôme Boudeau : Mais il nous est arrivé au Lieu Unique sur un spectacle en 360 avec la scène à l’intérieur de la diffusion que le saxo leader d’un groupe de jazz enlève ses ears directement à la fin du premier morceau et joue tout le concert avec le son de la diffusion.

SLU :Et pour le musicien, la WFS apporte un plus ?

Jérôme Boudeau : Pour les musiciens en plateau c’est très agréable, L’onde arrière du système est plus agréable sur la scène. Cela fait comme une amplification virtuelle pour le musicien. Et c’est très cohérent. Comme on utilise des enceintes de taille plus réduite avec une excitation sonore moindre, on évite beaucoup de pollution sonore par les réflexions acoustiques de la salle.

En plus, même en écoutant sur scène, l’image sonore est maintenue. Les musiciens nous rapportent toujours une grande satisfaction d’une sonorisation en WFS. Dans les petites salles, cela permet de diminuer les niveaux dans les retours. Malgré la latence, on ne les sent pas perturbés et quand on met la face derrière la scène, c’est juste une belle expérience pour les musiciens.

Florian Chauvet : Ce qui est intéressant dans la WFS c’est de lier l’audio au visuel. Par exemple, un musicien joue du synthé. Si ce sont des nappes, on place son objet sonore à une autre position que la sienne, on le voit jouer et ça ne pose pas de problème de raccord visuel. En revanche si c’est un véritable piano acoustique avec un son que nous plaçons à l’arrière sans le mettre dans le frontal, notre cerveau sera perturbé et nous remarquerons que ça ne fonctionne pas.

SLU : Tu sous-entends que nous devons apprendre à écouter en immersif ?

Florian Chauvet : Oui, c’est vraiment une éducation intellectuelle. C’est comme le binaural. Si l’auditeur veut maîtriser le binaural et percevoir correctement les placements et déplacements d’objets, il doit en écouter. Plus tu en écoutes, plus tu perçois l’immersif.

Un breton natif n’a pas de souci avec le son d’une bombarde, un balinais n’a pas de souci avec le son d’un gamelan ! Nos grands-mères avaient horreur du son de la guitare électrique quand elle a été inventée ! Maintenant ça ne pose de problème à personne. Une fois la chose entendue, notre cerveau s’y habitue, et n’est plus étonné. On apprend tout !

SLU : Devons-nous maintenant nous débarrasser de la stéréo ?

Jérôme Boudeau : Si l’on parle du live, oui. On a fait que ça. Il y a encore beaucoup de personnes qui disent que la stéréo c’est très bien et c’est très bien chez soi seul dans son salon ! C’est une habitude et une normalisation. Maintenant, l’immersif nous ouvre une grande expression artistique. Alors profitons-en pour écouter autrement.

SLU : Votre studio est-il adapté pour cela ?

Jérôme Boudeau : Une grande partie de notre projet c’est pour du live. Notre studio nous permet de faire de la simulation et de préparer des shows et des spectacles immersifs. Bien sûr, si une fois la production immersive terminée il faut produire une rendu en binaural ou en Dolby Atmos, nous pouvons le faire.

SLU : Quel cheminement suivez-vous pour créer un spectacle immersif ?

Florian Chauvet : En premier, s’il y a un besoin, nous créons du contenu immersif, par exemple de la prise de son binaurale ou 360. Ensuite nous gérons le mixage multicanal immersif sur tout type de configuration, car on peut adapter l’écoute au projet désiré. Nous faisons ensuite œuvre de consulting sur la tournée pour déterminer le choix du système de sonorisation en fonction des salles, avec quelle marque et enfin si nous gardons SPAT ou pas pour la scène.

Nous assurons également la régie du spectacle ou nous la préparons pour un autre ingénieur. Notre studio permet d’écouter le résultat immersif d’une production sans être obligé d’aller dans une vraie salle. Nous utilisons pour cela un nombre et un placement d’enceintes différents en fonction des projets. Cela va vite car elles peuvent passer d’une configuration à une autre sans démontage.

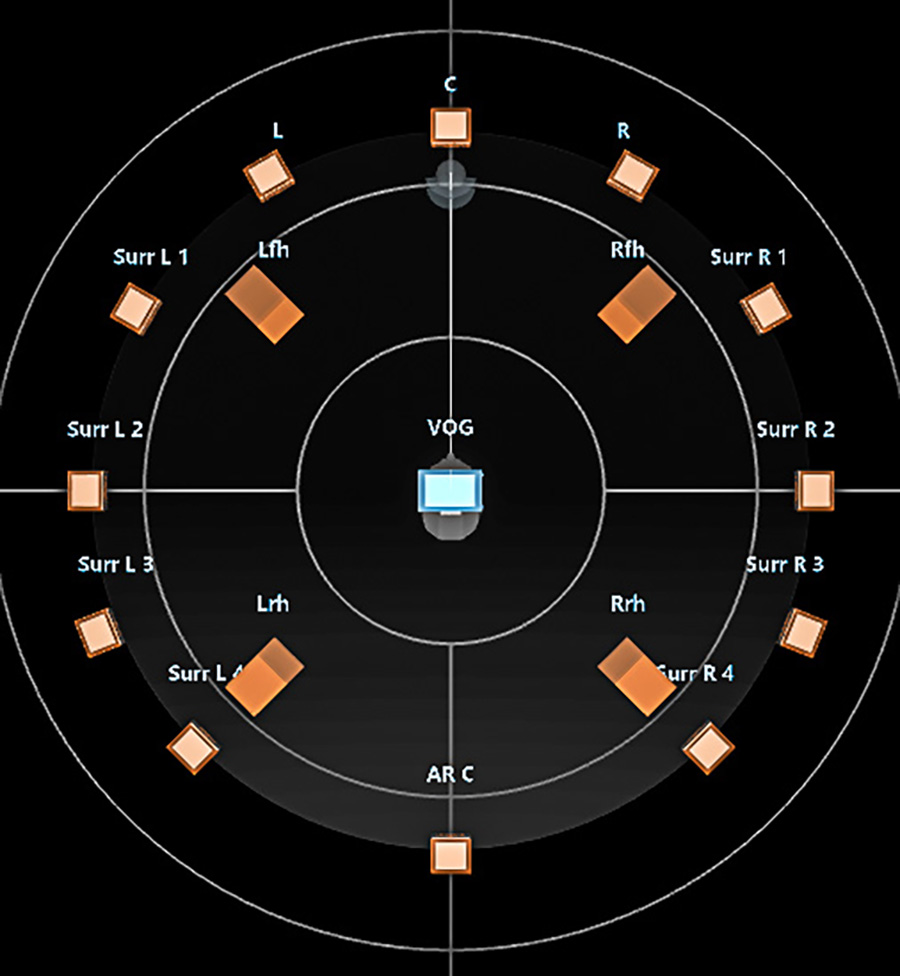

Nous avons malgré tout une config de base. On a 12 boîtes autour, avec une vraie stéréo avec un angle 30/30, un LCR et 9 en circulaire. Nous pouvons également exploiter une ligne frontal en WFS. Il suffit ensuite de dire à SPAT le nombre et le placement des boîtes et quel type d’algorithmes est choisi pour les gérer.

Au maximum pour une configuration immersive 3D totale, nous gérons un 25.1, c’est à dire 12 avec le frontal et le surround, 8 en élévation, une enceinte pour le centre plafond qu’on appelle généralement VOG (Voice of God) et 4 au sol, plus le canal subwoofer. Ceci nous permet entre autres de faire du Dolby Atmos.

Nous utilisons bien sûr le même modèle d’enceinte pour tous les points. Nous avons choisi la Tannoy Gold 8 qui nous paraît être un très bon compromis qualité prix, ce qui n’est pas négligeable quand on doit équiper son studio de 25 boîtes. Nous utilisons deux subwoofers Yamaha.

SLU : Pourquoi des enceintes coaxiales ?

Florian Chauvet : C’est fait pour nous. On a un respect parfait de la directivité et une cohérence horizontale et verticale primordiale (90 x 90). Nous avons une mise en phase plus simple. On peut sentir une différence avec des enceintes non coaxiales surtout si la personne qui écoute se déplace entre les boîtes.

SLU : Quelle station de travail utilisez-vous pour gérer et mixer vos sources ?

Florian Chauvet : Nous travaillons beaucoup avec Reaper car il est capable de gérer la lecture, l’enregistrement, les traitements et les bus avec des fichiers multicanaux aussi simplement qu’avec des fichiers mono/stéréo et peut gérer jusqu’à 128 canaux.

Nous utilisons les plugs SPAT Send pour envoyer les sons dans SPAT et les plugs SPAT Return pour ramener les sorties de SPAT dans un bus multicanal de Reaper, qui nous permettra de l’enregistrer facilement si nécessaire en un fichier multicanal.

Nous employons une carte son Metric Halo ULN-8 en USB-C, équipée de cartes MADI vers un convertisseur SSL. L’ordinateur est un Mac Studio qui nous donne une belle puissance de traitement pour SPAT, indispensable aussi pour le live.

Pour beaucoup de nos prises de son nous utilisons un microphone ambisonique de 3eme ordre Zylia-ZM1 équipé de 19 capsules qui nous permet d’enregistrer un fichier 16 canaux.

Par exemple, pour le concert au Lieu Unique, il y avait une pièce à côté de la scène. Au début du show, nous avons simulé que l’orchestre, que nous avions enregistré pour une autre occasion en ambisonique de 3ème ordre, jouait dans cette pièce en éloignant avec SPAT.

C’était tellement réaliste que des personnes allaient voir dans la pièce en croyant découvrir des musiciens.

SLU : Il y a aussi un paramètre de spread ?

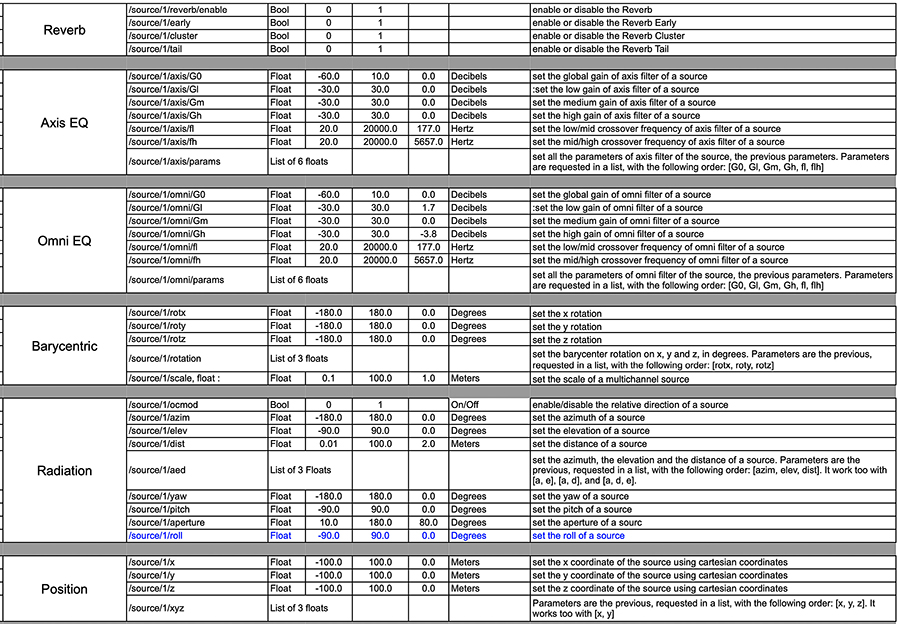

Florian Chauvet : Oui, SPAT propose de nombreux paramètres qui nous permettent de manipuler nos sons. On peut les faire tourner sur eux-mêmes avec le Yaw, ou utiliser le Spread pour réduire ou élargir leur diffusion. De nombreux autres paramètres de perception, de présence et de correction font de SPAT le logiciel immersif qui permet le plus de contrôle créatif sur les objets sonores.

SLU : Quels sont les formats d’objets sonores gérés dans SPAT ?

Florian Chauvet : Un objet sonore peut être mono, ambisonique, quad… ce qu’on veut. Je peux même récupérer un fichier Atmos. Imaginons un orchestre qui doit jouer sur une musique de film. Si le long métrage a été mixé en Atmos, je peux récupérer son mixage et le diffuser dans la room qui ne sera pas forcément de l’Atmos. SPAT fera un transcodage pour l’adapter automatiquement à la configuration immersive utilisée mais sans faire de miracles. Il faut rester cohérent dans ce que l’on veut transcoder.

Le format ambisonique est intéressant parce que c’est un format qui n’est pas lié à des positions d’enceintes. Il fournit une “boule” de son à 360 degrés, mais ne s’occupe pas de savoir si tu as deux, 4, 8 ou 16 enceintes pour le lire. Tu as donc un fichier multicanal en fonction du nombre d’ordre, si c’est un ambisonique d’ordre 3, tu as 16 canaux qui correspondent à des directions, des vecteurs de diffusion.

La room de SPAT, c’est à dire l’espace sonore dans lequel on mixe en immersif est bien entendu liée à des configurations d’enceintes. SPAT va donc faire ses calculs en interne pour diffuser les 16 canaux ambisoniques dans cet espace.

SLU : Comment mémoriser, automatiser le mixage immersif ?

Florian Chauvet : Avec l’OSC qui est exploité par de nombreux fabricants sur de nombreuses plateformes, audio, lumière, vidéo. Le protocole OSC permet, en fonction de son port et de l’adresse, de commander à distance n’importe quel paramètre. Il permet à un musicien qui est sur scène d’utiliser un simple potentiomètre pour commander un des paramètres du SPAT qui est en régie. C’est ultra puissant.

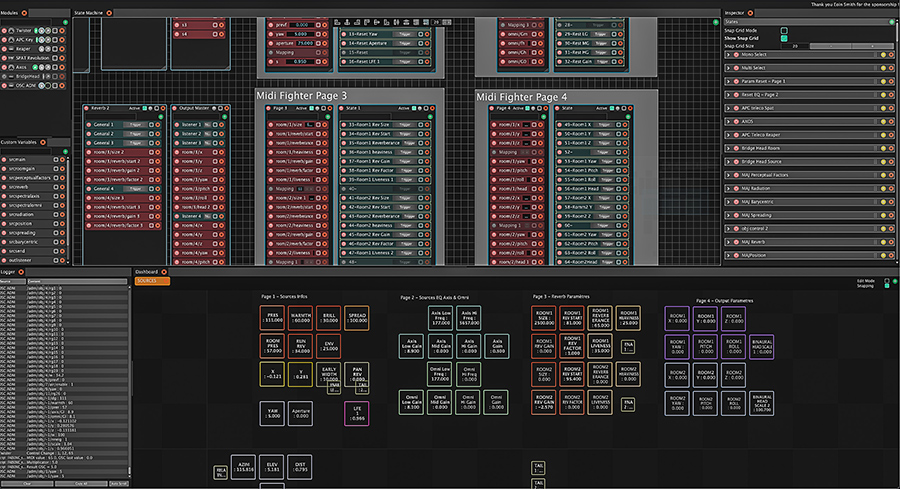

L’avantage de l’OSC est de permettre d’avoir plusieurs machines qui commandent via du réseau. Nous utilisons entre autres des contrôleurs MIDI Fighter. Ils sont équipés de potentiomètres sans fin avec switch de commande.

SLU : Sur un show, comment gérer les commandes de SPAT et d’autres équipements ?

Jérôme Boudeau : En live, nous devons avoir des boutons et non pas une souris. Avec le logiciel Chataigne, on crée des configurations Noisettes qui permettent de patcher n’importe quel langage avec un élément de commande physique. C’est un chef d’orchestre des données. On peut y gérer de l’OSC, du DMX, du MIDI, de l’artNet, des GPIOs… Tout passe par le réseau.

C’est un logiciel gratuit, mais il est bon de donner de l’argent pour que son créateur continue son développement ( NDR Tout travail mérite salaire). Je peux aussi commander le transport de mon Reaper, sélectionner des objets à l’aide d’une simple télécommande AKAI APC. En réalité, j’évite au maximum l‘utilisation de la souris. Merci à l’OSC.

En plus un protocole ADM OSC a été développé pour permettre d’unifier les langages de commandes propre à chaque fabricant. Flux, L-Acoustics, d&b, DiGiCo entre autres sont compatibles ADM OSC.

Cela veut dire que mes commandes faites en OSC pour SPAT peuvent très bien être utilisées pour commander L-ISA ou Soundscape installé dans une salle ou sur un concert ou une tournée.

SLU : Et pour le binaural ?

Florian Chauvet : Nous pouvons générer une Room binaurale à tout instant dans SPAT qui transférera tous les placements et mouvements d’objets dans un espace binaural. Par contre, pour les prises de son, nous utilisons notre tête artificielle, Maurice, indispensable pour faire de la prise de son binaurale native. C’est comme tes oreilles.

Par exemple, si tu veux diffuser un live en streaming, tu peux mettre la tête dans le public. C’est quand même onéreux. Tu peux aussi tricher avec une tête de coiffure dans laquelle tu peux loger tes micros, c’est un peu du bricolage mais ça peut le faire. Mais notre Maurice a en plus les épaules…

SLU : Le binaural permet-il d’avoir une parfaite sensation immersive ?

Florian Chauvet : Pour les mixeurs et les artistes, la porte d’entrée de l’immersif c’est le binaural. Mais tout le monde ne le perçoit pas de la même façon. Pour faire une écoute binaurale on utilise un traitement basé sur une fonction de transfert appelé HRTF (Head Related Transfer Fonction) qui simule les paramètres d’écoute générés par une tête humaine. C’est l’empreinte d’une tête. Or personne n’a la même tête. Il existe plusieurs types de HRTF proposés par les systèmes.

Il faut donc trouver celle qui te correspond le mieux. Certains fabricants permettent de créer ta propre HRTF à l’aide d’un smartphone et d’un bon appareil photo. En plus, en écoute binaurale, nous n’avons souvent pas de corrélation visuelle pour aider à positionner les sons, donc nous devons les imaginer. Nous avons une discrimination précise dans les 160° horizontaux de notre vision.

En revanche cela se gâte avec un discrimination verticale très mauvaise. Sans indication visuelle, il est difficile de savoir de combien une source sonore est élevée. Et à l’arrière on n’est pas très bon. Derrière, un peu à gauche ou à droite, on ne sait pas vraiment. Tout ça dépend de la charte HRTF qui simule la tête.

Par exemple avec le système de in-ear spatialisé de Klang, le résultat binaural est excellent. Ils ont développé une charte qui fonctionne parfaitement bien, La HRTF moyenne idéale c’est la quête du graal. Une bonne manière d’appréhender sa perception du mix binaural est d’écouter le célèbre enregistrement du virtual barber shop. Il y a une période d’apprentissage pour apprécier le binaural.

SLU : L’immersion engendre-t- elle un surcoût de production ?

Jérôme Boudeau : Depuis un an, on voit bien l’explosion de l’immersif. Une SMAC comme Le Temps Machine a installé un système Soundscape et des boîtes d&b. Nous avons des festivals et des tournées en immersif. En conception, je ne pense pas qu’on peut parler de surcoût. La durée de création n’est pas plus longue. Au niveau de la diffusion, on a tendance à parler d’un e augmentation d’environ 20%. Mais c’est compliqué de généraliser. Dans certains cas, ce n’est pas forcément plus onéreux. Cela va dépendre des configurations et des types de salles.

SLU : Il faut des techniciens en plus ?

Jérôme Boudeau : Nos métiers évoluent sans cesse. Avant le mixeur faisait tout. Le mix, le calage système et tout passait dans des câbles analogique. Maintenant il y a le mixeur, le caleur système, le responsable réseau sur les grosses opérations, le régisseur HF et maintenant nous rajoutons le régisseur immersif. C’est dans la logique des choses.

Après, dans une DiGgiCo ou une S6L Avid, le technicien a le plug de SPAT directement sous la main pour piloter le placement des objets, ce qui lui donne de l’autonomie. Ce principe de plugins n’est pas uniquement disponible chez Spat. L-Isa et Soundscape en ont également.

Florian Chauvet : Le problème que je vois plutôt ce sont les amplis. Il nous faut beaucoup de canaux. L-Acoustics vient de sortir le LA7.16i, un ampli qui en offre 16 en 2U. C’est très intéressant pour l’immersif car ce sont les amplis qui reviennent cher. Ce problème est en train de se régler. Pour ce qui est de l’installation, on a tendance à dire qu’il faut plus de ressources humaines. Je proposerai à quelqu’un de câbler une ligne WFS de 10 boîtes, une tous les mètres, en filaire brin par brin, et je lui proposerai aussi de câbler en filaire brin par brin, un line array. Je pense qu’il mettra plus de temps. Mais pour les line arrays, nous avons créé des multis tout faits.

De la même manière, les loueurs prépareront des faisceaux pour la WFS. Il en va de même pour les outils de commande, nous devons les formaliser. Soit tu es sur une grosse tournée et tu utilises une DiGiCo ou une S6L et les plugs de ta solution de matriçage, ou soit tu es en théâtre-danse avec des petites consoles, et tu utilises par exemple SPAT avec des contrôleurs MIDI et Chataigne. Nous pouvons donc mettre au point les outils pour nos clients en vertu de ce qu’ils ont. Une sorte de sur mesure.

SLU : Un calage de système immersif c’est plus compliqué ?

Florian Chauvet : Pas vraiment et pas plus compliqué qu’un calage de line array. Nous devons avoir toutes nos enceintes identiques. Nous ne ferons que du calage en amplitude. Aucune compensation de délai car c’est la WFS qui le gère. Il faut juste équilibrer le système, on aligne sub, tête et EQ. Ce n’est pas plus compliqué. On nous pose souvent la question des subs. Pour nous c’est un LFE.

Sur de la WFS, on peut mesurer n’importe où et on peut placer la régie où l’on veut, car on a le même son partout. Bien sûr, on ne va pas se caler au mur ou se mettre sous un balcon. Le gros point c’est qu’il met moins en exergue les défauts du lieu et c’est très intéressant de s’en affranchir plus qu’à la normale.

SLU : Quelle acoustique pour un studio immersif ?

Florian Chauvet : L’important est d’avoir une acoustique la plus neutre possible. Il nous faut les quatre murs et le plafond cohérent. Nous utilisons deux bass traps actifs AVAA de PSI. Le résultat est étonnant ! En gérant les modes propres de la pièce, le grave est plus compact et ça supprime le masquage.

SLU : Y a-t-il une manière d’appréhender un mixage immersif ?

Florian Chauvet : C’est ce qui est intéressant, on se retrouve comme un gamin sur un terrain de jeu très vaste, comme s’il n’y avait plus de lignes blanches. C’est vrai que l’immersif est simple à mettre en place. En revanche qu’est-ce qu’on en fait ? Cela demande beaucoup de travail et d’expérience. Comme je n’ai plus de problème de masquage, j’entends tout le monde, mais est-ce que c’est beau ? Parfois j’ai envie que ça soit un peu plus sale, mettre un peu plus de glue. Et cela demande d’autres méthodes qu’avec de la stéréo.

Je passe une grande partie de mon temps à prendre de la matière sonore et à essayer des mixes. En plus le cerveau est très malin, Une scène qui ne bouge pas au bout de quelques minutes perd son caractère immersif. Tu dois faire bouger des choses très légèrement pour le solliciter régulièrement. Par exemple, si tu veux mettre en avant un instrument dans un mix immersif, tu le fais bouger sur une très faible distance, et automatiquement le cerveau va le distinguer et va mieux l’entendre sans avoir touché son niveau. C’est beaucoup de psychoacoustique.

En WFS, tu lies le visuel à l’audio ce qui est pour moi un truc essentiel. Si tu mets un pot de fleur sur scène en plein milieu du plateau et que tu veux faire chanter cette fleur, en WFS tu peux vraiment faire sortir le son du pot de fleur. Et pourtant pour le comédien c‘est particulier car avant, on aurait mis un haut-parleur dans le pot de fleur, et le comédien aurait bien entendu le son qui sort du pot. Avec la WFS, c’est dans la salle qu’on l’entend, le comédien n’aura donc pas cette image sonore. On voit donc que cela a des conséquences sur la façon d’appréhender la sonorisation immersive.

SLU : Comment commences-tu un mix en immersif ?

Florian Chauvet : L’élément le plus faible définit le niveau le plus élevé de mon mix. C’est une de mes règles sur les mixages standard. J’ouvre tout. Si c’est en WFS tu entends tout le monde. Je commence par l’élément le plus important. Et je vais ensuite faire vivre les choses autour. S’ils y a beaucoup de nappes je vais pouvoir élargir.

Si j’ai beaucoup de rythmique je vais les garder assez centrées. En live, il doit y avoir le raccord avec le visuel, et donc au moins dans le frontal. Cela dit, rien ne nous empêche de dupliquer les objets, d’en mettre un à l’endroit original et de mettre des ersatz vers l’arrière avec du filtrage ou de la réverbe. On tombe là dans le domaine créatif, bien sûr en tenant compte du propos artistique.

SLU : Comment définis-tu des espaces en immersif ?

Florian Chauvet : Une des grandes forces de l’immersif est de pouvoir recréer une réverbération. Si l’ingénieur du son a déjà des réverbes, je les intègre en objets dans le SPAT, je les place comme il en a l’habitude et ensuite je peux les écarter. Une autre solution est de dupliquer l’objet de reverbe et d’en placer une devant et une derrière. Cela fonctionne très bien.

SLU : Comment gérer les sons graves qui sont plus difficiles à localiser ?

Florian Chauvet : C’est un vaste sujet. On dit que le grave est omni, c’est faux. Il est diffus mais pas omni. Si un caisson de grave est dans le coin d’une pièce, tu sens bien que le son vient de là. Si tu mets quatre caissons de graves dans les quatre coins de la pièce, tu peux faire tourner du grave.

C’est très intéressant sur des nappes ou des basses de clavier assez espacés et on voit bien que le grave en immersif devient plus un effet que dans une sonorisation classique.

En immersif on laisse les enceintes en full range et on utilise le caisson de grave que pour le LFE. Avec un complément d’installation, on garde généralement le grave du système, soit il est accroché au centre ce qui pour moi est idéal et on va rajouter un canal LFE supplémentaire pour faire de la spatialisation. Le sub ajouté sert forcément de subs LFE qui ne dépendent pas des subs du système.

SLU : Le détimbrage est fréquent ?

Florian Chauvet : En WFS impossible de faire des déplacements rapides sans détimbrage et artefacts, Pour des déplacements rapides le plus efficace est le VBAP. Chaque système a son moteur qui essaye de détimbrer le moins possible. Dans SPAT, c’est de très bien réussi.

SLU : As-tu la possibilité de préparer la spatialisation d’un show dans SPAT ?

Florian Chauvet : Oui. J’importe la scène sous forme d’une image jpeg. Si par exemple j’ai un plan de scène à l’échelle d’un orchestre symphonique, je peux le mettre dans l’écran de SPAT, je peux placer chaque musiciens et mon SPAT est déjà préparé. Pareil avec un plan de scène de groupe.

SLU : Et pour suivre les mouvements physiques des comédiens sur scène ?

Florian Chauvet : On fait du tracking. A Nantes, nous avons la chance d’avoir le société NaoStage qui permet de faire du tracking avec des caméras. Sur une scène sans décor, c’est ultra rapide car on n’utilise qu’un seul système de détection. Le système va envoyer le x et y des comédiens en OSC que je vais récupérer dans le SPAT, et quand le comédien se déplacera, l’objet qui correspond le suivra.

SLU : Quelle solution pour l’archivage ?

Florian Chauvet : Si on veut garder tous les objets, le mieux est de garder une copie de son multipiste, Reaper chez nous, et une copie de la session SPAT. En réalité, une copie de la session Reaper suffit car on mémorise les mouvements des plugs SPAT qui envoient de l’ADM-OSC. Donc avec n’importe quel système de spatialisation compatible ADM-OSC, on retrouve ses placements et ses positions.

Si on veut garder une archive définitive de la matière sonore, on sort tout simplement un fichier multicanal, mais on perd les objets. Une autre solution très intéressante est de générer un fichier de sortie ambisonique qui devient agnostiques d’enceintes, par exemple d’ordre 7 pour avoir un maximum de précision. Ce fichier ambisonique du spectacle, tu peux le diffuser ensuite dans ce que tu veux, 2 ,4, 8 etc… SPAT permet de générer ce fichier ambisonique et Reaper permet de l’enregistrer et de le lire.

SLU : Les pièges à éviter ?

Florian Chauvet : Le mauvais goût. On n’est pas là pour faire tourner les serviettes. Si on n’a pas besoin de mouvement, on ne fait pas de mouvement. Le premier travail est de créer une room avec une réverbération 360. SI on fait des mouvements ils sont très fins sauf si intégrés à la composition.

En tant que mixeur qui accueille un groupe, on fait déjà du statique et on crée des espaces. L’erreur est de mettre ailleurs que dans le visuel. Si on voit une source instrumentale acoustique, elle doit être en frontal quoi qu’il arrive.

SLU : Et les échanges avec les artistes ?

Florian Chauvet : Cela se passe très bien, mais tu n’imposes pas un mix objets à un artiste s’il n’est pas d’accord. Dans le live, en accueil d’un ingénieur, je lui laisse faire son mix, que je place dans la stéréo, et ensuite seulement je lui propose de sortir différents instruments.

Je lui demande la voix en direct out et je vais lui créer un objet que je vais placer dans l’enceinte centrale avec un peu de spread pour l’écarter et que tout le monde l’entende bien, et il va trouver ça très intéressant.

Je peux ensuite continuer sur les claviers, puis je vais les placer un par un. Il va retoucher sa correction dans le mix stéréo parce que l’instrument sort mieux, et ainsi de suite.

Pour le moment, on nous appelle surtout pour préparer la diffusion. Mais nous avons maintenant des créateurs qui viennent chez nous avec des préproductions en binaural ou en Atmos. Nous reprenons leur sessions et nous les adaptons facilement dans SPAT.

Nous pouvons aussi adapter la diffusion dans des salles différentes. Nous avions un spectacle qui a tourné dans des salles de 150, 500 et 1000. Dans SPAT je replace les enceintes et go. Je rejoue toutes les automations dedans sans rien retoucher et ça fonctionne, C’est quand même génial.

SLU : Quelque chose à rajouter ?

Florian Chauvet : Petite précision. Nous avons beaucoup cité les systèmes SPAT, L-ISA et Soundscape, mais il existe d’autres systèmes tout aussi intéressants comme la Fletcher Machine d’Adamson, le SpaceHub de chez Coda, le Ness de chez APG ou l’Holophonix de chez Amadeus. On les voit moins mais ils ne sont pas moins performants pour autant, et ont chacun leurs avantages. Je vous invite à les découvrir si ce n’est pas déjà fait.

Plus mûre est la chute

La diffusion spatialisée est en plein essor. Depuis quelques mois, salles de concerts, festivals et tournées d’artistes utilisent l’immersif pour le plaisir de son public et une démarche artistique sublimée. Les fondateurs de La FabSonic ont bien anticipé ce phénomène en créant une des premières structures pour accompagner cette mutation pratique et créative. Alors soyez prêts, car avec La FabSonic, l’immersif peut être partout autour de vous.

Pour avoir plus d’infos encore sur le site La FabSonic

Et pour découvrir chacun des systèmes cités :

– SPAT Revolution de Flux

– Chataigne de Ben Kuper

– L-ISA de L-acoustics

– Soundscape de d&b

– Fletcher Machine d’Adamson

– SpaceHub de Coda

– NESS d’APG

– Holophonix d’Amadeus