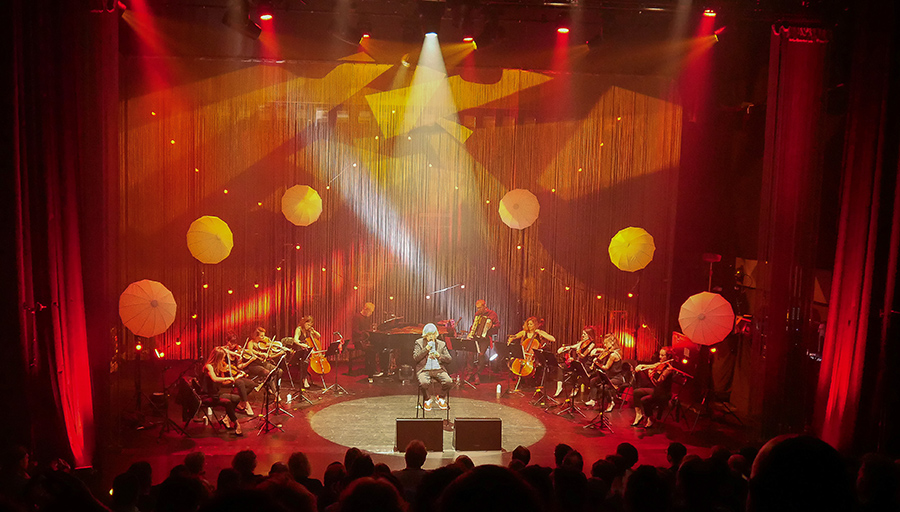

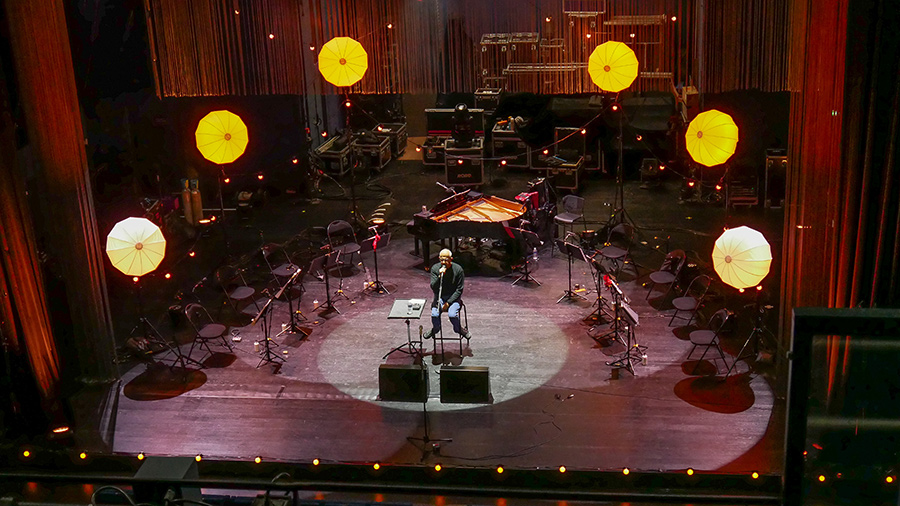

La salle parisienne de La Scala impressionne par la vue plongeante sur la scène qu’elle offre aux spectateurs depuis ses balcons, et leur très grande élévation. Le premier est bien gradiné et le deuxième l’est encore plus. Autant dire que la sonorisation d’un espace aussi atypique est plutôt complexe.

Nous y retrouvons Madje Malki à la façade, Quentin Nivromont d’Amadeus aux commandes du système HOLOPHONIX et enfin Alexis Beyer, directeur technique de la salle, pour l’un des concerts parisiens de la tournée “Dans mes Cordes” de Renaud.

Ils nous donnent leurs impressions sur la sonorisation spatialisée de ce spectacle, riche de sa formule acoustique dans l’intimité de cette salle d’exception, remplie pour l’occasion par l’énorme émotion qui relie le chanteur à son public.

SLU : La Scala est une salle vraiment particulière et son système son aussi ?

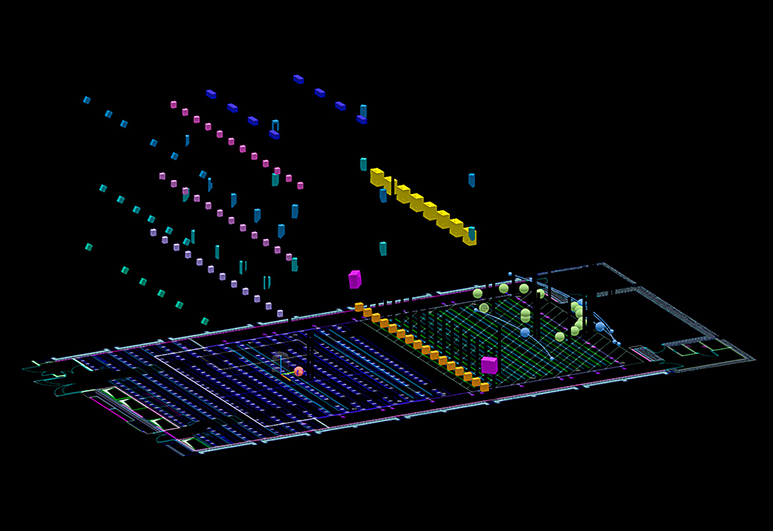

Quentin Nivromont : La Scala Paris, c’est une des premières salles qui a été équipée en HOLOPHONIX. L’un des avantages du système est qu’il est poly-algorithme. On peut donc avoir plusieurs algorithmes de spatialisation en même temps, pour les mêmes objets.

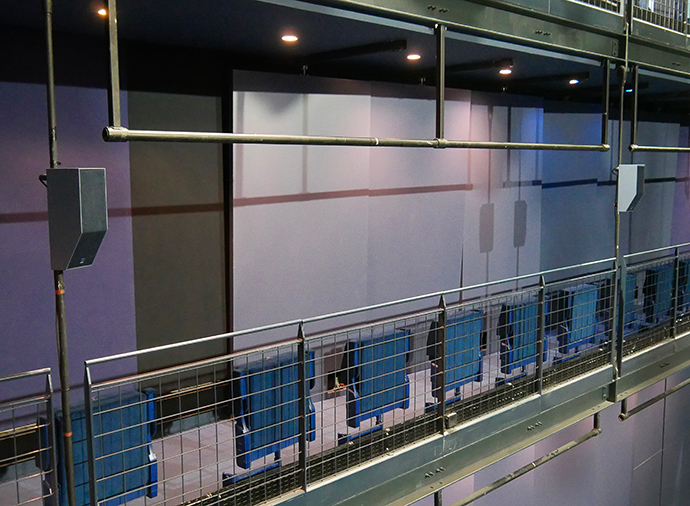

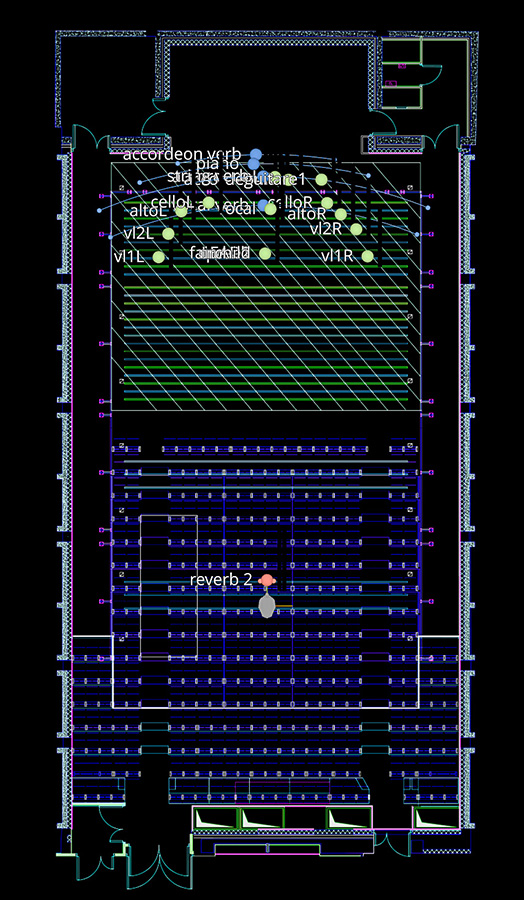

Nous avons ici une double configuration frontale, en WFS sur plusieurs plans : huit enceintes trois voies (tri-axiales) Amadeus C15 en face, une rampe de front de scène sur-mesure et des systèmes de rappels composés chacun de douze enceintes Amadeus PMX 4 au niveau du parterre et de chaque balcon.

SLU : Et nous avons des enceintes pour le surround ?

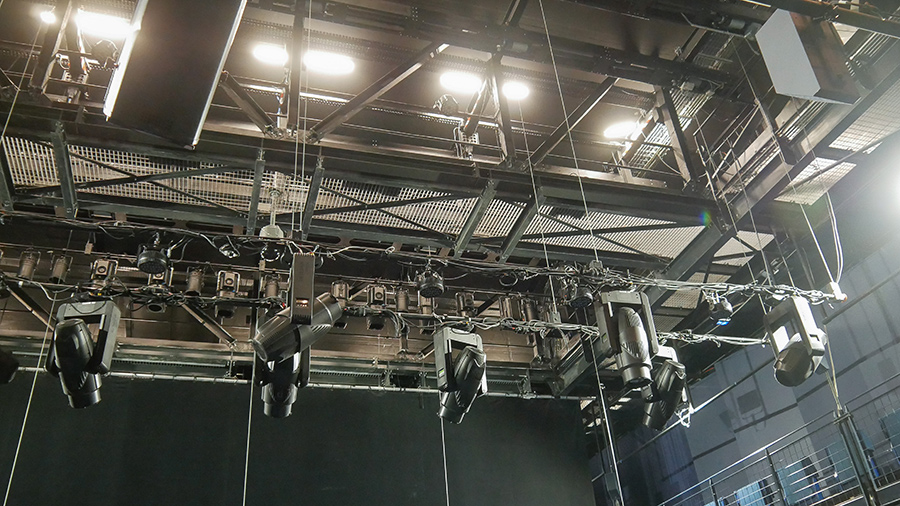

Quentin Nivromont : Oui, nous gérons en plus du plan frontal, un plan que nous appelons immersif ou surround. Il se compose de plusieurs systèmes d’enceintes réparties sur toute la périphérie de la salle, au niveau de l’orchestre et au niveau des balcons. Nous terminons le dôme par huit enceintes positionnées au plafond et qui rayonnent vers le bas.

Elles sont disposées en groupe de quatre et fixées sur les deux passerelles techniques. Une sonorisation avec un dôme aide beaucoup à l’impression immersive du spectateur dans la salle et nous nous en servons surtout pour les réverbérations. Nous avons aussi des lignes de surround pour l’arrière.

SLU : Je vois des enceintes à cour et jardin?

Quentin Nivromont : En effet, nous y avons installé des subwoofers. Ils sont accompagnés chacun d’une C15, posée dessus, en stéréo. On s’en sert pour redescendre un peu l’image sonore. Ici, habituellement il n’y a pas de rampes de front-fill, donc l’image WFS est très haute, surtout pour l’audience installée au niveau de l’orchestre.

Ces deux C15 nous permettent de récupérer du timbre et de redescendre un petit peu l’image sonore avec un très faible impact sur la spatialisation. C’est la solution idéale quand on a une ouverture comme ça, avec une si grande hauteur.

Quand il y a des comédiens au plateau, l’effet de préséance joue beaucoup et le fait d’entendre le son direct rectifie la perception. En revanche, dès qu’il y a de la diffusion de son avec peu de champ direct, nous utilisons obligatoirement ces deux C15 pour redescendre l’image.

SLU : Et pour les balcons ?

Quentin Nivromont : Le dernier balcon de la Scala est très haut et très incliné. La ligne de rappel est très discrète. Comme nous sommes dans un tout petit volume, elle est très proche du public. Mais avec l’avantage du son spatialisé, le spectateur n’a pas l’impression que le son vient de la ligne ou d’une enceinte en particulier.

SLU : Je vois également une rampe étonnante au sol et qui épouse parfaitement tout le front de scène ?

Quentin Nivromont : Une rampe sonore de front-fill avait été conçue et fabriquée spécifiquement en 2021 par Amadeus pour La Scala Paris. Elle était destinée à couvrir très finement l’audience des premiers rangs qui sont très près de la scène, et à redescendre encore l’image sonore. Quand La Scala Provence a ouvert en 2022, la rampe de La Scala Paris a migré à La Scala Provence et n’est pour le moment jamais revenue, tant elle sert là-bas…

La rampe sonore que tu vois ici est la toute première fabriquée par Amadeus pour le Théâtre National de Chaillot (Salle Jean Vilar), actuellement en cours de rénovation. Cette rampe a été rachetée par l’Institut du Monde Arabe, qui nous l’a prêtée pour l’occasion.

Un bel exemple de collaborations entre institutions culturelles publiques et privées… Cette rampe intègre deux transducteurs coaxiaux de 4” par élément. La face avant reprend la courbure des premiers rangs du gradin de la Salle Jean Vilar, à savoir 13°.

SLU : Le premier rang est quand même très près ?

Quentin Nivromont : Justement, nos rampes sont faites pour cela, et conçues afin d’y répondre. La distance entre les transducteurs (distance inter-acoustique) est déterminée de sorte à ce que chaque spectateur soit à minima dans le champ (dans la directivité) de trois transducteurs. En WFS, le public des premiers rangs entend parfaitement l’image du plateau sans effet gênant de radiation directe car le niveau par boîte est très faible.

SLU : Le système est extrêmement discret. Je suis étonné que vous arriviez à une cohérence sur l’ensemble du parterre.

Quentin Nivromont : En fait, le front-fill vient vraiment couvrir les premiers rangs. Jusqu’à la moitié de la salle, tu as un mix entre le front et le haut, ensuite tu arrives dans les rappels. Mais sans la rampe du front, effectivement, l’image centrale serait trop élevée et le public aurait tendance à lever la tête.

SLU : Ce type de rampe, c’est une des particularités des systèmes de diffusion Holophonix ?

Quentin Nivromont : Oui. Nous développons des enceintes totalement adaptées à cet effet. Très récemment à la Cour d’Honneur du Palais des Papes dans le cadre du Festival d’Avignon, nous avons développé des rampes de front-fill un peu particulières qui permettent de projeter le son pour une majorité des 1 200 places sur le gradin. Cette immense ‘barre de son’ de quelques 30 mètres de long est posée au nez-de-scène.

En complément, deux lignes sources verticales à rubans baptisées Les Colonnes d’Avignon permettent, un peu comme ici les C15, de ramener un peu d’énergie, de réponse et de cohérence en haut de gradin. On s’en sert comme rappel. Mais l’essentiel du système, c’est un front-fill de très grand format, un peu comme ici.

SLU : En tout, cela fait beaucoup d’enceintes ?

Quentin Nivromont : À La Scala, le système HOLOPHONIX gère une centaine d’enceintes. Le serveur dispose de 128 sorties. Une grande partie de ces enceintes a été conçue spécialement pour ici.

C’est une de nos particularités en tant que fabricant d’enceintes, nous pouvons fabriquer des modèles totalement adaptés aux exigences de diffusion et de spatialisation d’une installation fixe.

SLU : Le système HOLOPHONIX peut être utilisé avec d’autres enceintes ?

Quentin Nivromont : Oui. Quand nous équipons une salle comme ici, nous associons le processeur HOLOPHONIX dans sa version serveur (processeur) avec nos systèmes d’enceintes. Mais nous proposons aussi une version baptisée “HOLOPHONIX Native” qui fonctionne sur macOS. La version Native gère moins de sorties. Elle est pensée pour les tournées en s’adaptant à tout type d’enceintes de diffusion.

SLU : Comment gérez- vous la spatialisation dans l’HOLOPHONIX ?

Quentin Nivromont : Nous gérons des objets sonores que nous appelons des sources virtuelles. Le terme source vient de l’IRCAM qui développe les algorithmes de spatialisation que nous utilisons dans HOLOPHONIX. Nous envoyons une source vers des bus qui disposent chacun d’un algorithme de spatialisation, WFS ou autre.

Ensuite, les bus sont dirigés vers les enceintes. Une enceinte peut ainsi être utilisée par plusieurs bus. Par exemple, je peux très bien terminer mon système de surround en utilisant des enceintes qui sont aussi dans une WFS. Les enceintes sont autonomes. C’est-à-dire qu’une enceinte n’est pas liée à un bus de spatialisation. Elle peut être multifonction.

SLU : On peut dire que le logiciel traite chaque enceinte de manière indépendante ?

Quentin Nivromont : Oui, ce que je veux dire, c’est que dans la plupart des systèmes, le mode de spatialisation est lié à un système d’enceintes et si tu veux mélanger par exemple une Ambisonie avec une WFS, tu dois avoir des systèmes d’enceintes différents. Tu ne peux pas doubler la diffusion vers les mêmes enceintes. Nous, on peut. Comme tu viens sommer du signal, il faut donc être attentif.

SLU : Dans la solution HOLOPHONIX, il y a beaucoup de briques de l’IRCAM ?

Quentin Nivromont : En fait, HOLOPHONIX est développé en partenariat avec l’IRCAM. C’est eux qui nous fournissent le moteur audio, que nous codéveloppons et perfectionnons ensemble au quotidien. Nous nous occupons de toute la partie interface utilisateur et évidemment du hardware. Nous avons créé un programme de recherche commun depuis ce début d’année 2023, baptisé Continuum.

Nous avons acquis beaucoup d’expérience concernant la WFS, notamment au Palais des Papes à Avignon et au sein de beaucoup d’institutions culturelles majeures (Théâtre National de Chaillot, Comédie Française, CDN de Normandie, Panthéon…). Cela nous amène à partager un développement mutuel. Continuum porte principalement sur des sujets de réverbération et d’acoustique active, pour permettre de transformer l’espace et l’acoustique d’un lieu.

SLU : Vous offrez une solution de spatialisation complète ?

Quentin Nivromont : Oui, nous avons une considération de l’enceinte et une vue 3D du lieu. C’est notre force en tant que fabricant d’enceintes. Nous utilisons souvent nos boîtes de la série C, qui sont toutes point source (coaxiales ou tri-axiales) pour la cohérence de phase et développées dans de nombreuses tailles, comme les C15 trois voies 15” qui sont largement utilisées ici. Nous sommes également en train de développer des enceintes de plus petite taille comme les C3 et les C4, pour gérer des lieux de format plus réduit ou des installations en studio pour de l’Atmos par exemple.

SLU : Comment gérez-vous la diffusion dans les basses fréquences ?

Quentin Nivromont : Nous avons récemment développé une version de la C15 avec une réponse plus étendue dans le grave, la C15B. Cette enceinte de grave est close et anime un radiateur passif à très grande élongation en face arrière. La Scala Provence est le premier lieu en France équipé avec ce nouveau modèle. Nous les utilisons en alternance, une C15, une C15B, en WFS et cela nous permet d’avoir du grave extrêmement bas qui est spatialisé.

Nous étendons ainsi la spatialisation dans les basses fréquences pour garder de la cohérence sur la diffusion du bas du spectre dans le front d’onde, et éviter qu’une source perde sa spatialisation si elle descend en fréquence. Ici pour le concert de Renaud, nous ajoutons deux subwoofers pour générer de l’infra basse en stéréo avec deux caissons en 18” et tout est parfait.

SLU : Avez-vous une solution qui permet de recréer une réverbération ?

Quentin Nivromont : Oui, paramétrique pour l’instant. Des projets de réverbération régénérative et par convolution sont en cours, au travers du projet Continuum comme évoqué avant. Nous profitons d’une bibliothèque d’empreintes de vraies acoustiques qui existe à l’IRCAM. La question pour nous c’est comment mettre ça en place de manière pratique pour l’utilisateur. Il faut trouver les bons paramètres pour que ce soit simple à employer et efficace en termes de ressources.

SLU : Pour ce concert de Renaud, vous avez beaucoup de sons acoustiques directs

Quentin Nivromont : Oui nous avons une belle orchestration avec beaucoup d’instruments acoustiques dont un sextuor, un accordéoniste et un pianiste. En plus, la violoniste et la violoncelliste jouent aussi de la guitare. En direction de jeu, cela joue de manière très intimiste, pas pour projeter. Comme les musiciens sont en in ear, ils s’adaptent parfaitement en niveau et n’ont pas tendance à jouer fort.

Et pour la voix de Renaud, qui ne se projette quasiment pas dans la salle, nous avons un travail de spatialisation pour permettre au public de bien le situer là où il est. Le but c’est d’avoir une forte cohérence sans toutefois avoir l’impression d’entendre quelque chose de très fort, pour garder toute l’intimité propre à cette formule artistique.

SLU : En réalité vous n’utilisez pas tous le système d’enceintes pour ce concert de Renaud?

Quentin Nivromont : Pour ce concert, je n’utilise essentiellement que de la WFS et peu de surround car celui-ci n’est pas nécessaire. Nous n’utilisons pas les réverbérations du système HOLOPHONIX et je me contente de replacer dans l’espace celles de Madje.

Nous en avons profité pour travailler en 96 kHz, ce qui demande beaucoup de ressources au serveur qui est d’une ancienne génération, et nous avons donc économisé quelques points de diffusion. Une des qualités du système HOLOPHONIX est d’être très adaptatif.

SLU : Quelle structure de distribution pour le serveur HOLOPHONIX ?

Quentin Nivromont : La distribution des signaux de la console au serveur et depuis le serveur vers l’amplification se fait en Dante. Amadeus travaillait historiquement avec Lab.gruppen et LAKE et depuis près de dix ans également avec Powersoft. Nous avons ici des Ottocanali 8K4 DSP+D et des X8 DSP+DANTE chacun offrant 8 canaux.

SLU : Et depuis la console de Madje ?

Quentin Nivromont : Il sort de son Avid S6 en MADI, je convertis en DANTE. Il nous envoie tout simplement les sources audio par des sorties directes et des bus de sorties.

SLU : Comment commande-t-on un serveur HOLOPHONIX ?

Quentin Nivromont : On accède au serveur via une simple page web sur un ordinateur. On peut aussi, depuis une console ou d’autres contrôleurs, utiliser le protocole ADM OSC pour commander chaque paramètre des sources sonores. Ici sur ce concert, nous utilisons le système de spatialisation essentiellement pour la WFS et la sonorisation efficace de la salle, donc pour permettre à tout le public d’avoir une belle expérience sonore, fidèle et optimale quelle que soit sa position.

Nous ne sommes pas dans le cadre d’un spectacle immersif où il y a beaucoup de déplacements de sources sonores à exécuter. Le seul instrument qui bouge est la guitare, ceci dû à la scénographie qui est plutôt figée. En revanche pour le théâtre, nous avons des techniciens qui font des suivis de comédiens à l’aide d’iPad. Il y a bien sûr les solutions de tracking automatique mais pour l’instant, les budgets sont si conséquents qu’elles entraînent certaines réserves et sont donc uniquement utilisées par des productions de très grands formats.

SLU : Vous proposez différents algorithmes de spatialisation ?

Quentin Nivromont : Nous faisons essentiellement du spectacle vivant, où y a beaucoup de frontal. Nous préférons la WFS pour cela. Nous avons deux façons de traiter la WFS. Quand on déplace une source, il y a deux façons de calculer les délais. La première est de glisser le temps de délais, mais si le mouvement est rapide, on entend des clics ou des effets Doppler qui changent la hauteur du son. Nous n’utilisons pas cette option. Nous préférons les crossfades entre deux délais. Quand on déplace la source, cela va uniquement provoquer un filtrage en peigne qui va dépendre du nombre d’enceintes.

Sur ce principe, nous proposons deux modes de WFS : Minimal Délai et Full. Nous avons vu que pour la WFS, on calculait les délais et les gains pour chaque enceinte. Ça c’est l’option Full (ou Minimal Delay désactivé). Si on prend une source et qu’on la recule sur la scène, on augmente le temps pour arriver aux enceintes, ce qui est parfait pour le renforcement sonore. On a une source qui met du temps à arriver au premier rang et on essaye de reproduire ce délai. En revanche avec une grosse caisse par exemple, de grands temps de délai vont créer des flas.

Avec l’option Minimal Délai, nous calculons le temps de délai pour chaque enceinte et on enlève le retard de l’enceinte la plus proche. Cela permet d’avoir toujours au moins une enceinte sans délai dans la WFS et cela suffit à éviter d’entendre un flas.

Nous avons également d’autres algorithmes qui permettent de faire de la multidiffusion, de l’ambisonique, du binaural, du panning d’amplitude, de la simple stéréo pour une captation pendant le show, et tout ça en même temps. Cela permet de s’adapter à tous types de salles et de spectacles.

SLU : Et des panoramiques … j’ai entendu parler du KNN ?

Quentin Nivromont : L’utilisateur peut choisir parmi 6 algorithmes différents de panning d’amplitude. De la stéréo au VBAP. Nous apprécions particulièrement dans les configurations exotiques le KNN. Inspirée d’une méthode d’apprentissage informatique, cet algorithme utilise les enceintes les plus proches de la source virtuelle pour en reproduire la position. Le son est réparti avec des différences de niveau sonore. Il y a beaucoup de paramètres pour créer des effets très créatifs ou gérer des ensembles de diffusion un peu étranges. Il donne un très bon contrôle de l’énergie envoyée à un endroit de la diffusion.

SLU : Et ici pour La Scala ?

Quentin Nivromont : A La Scala nous avons deux bus WFS, un pour la face et un pour le rappel. Dans une installation fixe comme ici, nous avons déjà tous les placements d’enceintes qui sont définis. Tout se calcule déjà. Je rajoute un troisième bus WFS pour le front fill ce qui fait que toute la salle est en WFS. L’avantage d’avoir des lignes différentes est de pouvoir ajuster l’image sonore entre les différents plans. Si l’ingénieur veut une correction spectrale, il pourra le faire en appliquant une correction générale par bus.

SLU : Comment cale-t-on un système de sonorisation spatialisé plutôt complexe comme celui de La Scala ?

Quentin Nivromont : Plusieurs méthodes. Souvent avec un réseau de micros de mesure, pour comparer les gains et la réponse à différents endroits. Nous corrigeons généralement chaque enceinte indépendamment sans processing HOLOPHONIX, donc en Direct To Master ou en routing direct sur les amplificateurs. Nous plaçons plusieurs micros dans l’axe, et dans la directivité verticale théorique des enceintes.

Cela permet d’en corriger certaines qui auraient un rapport différent à l’acoustique de la salle ; par exemple chargées par une paroi, un réflecteur, etc. On harmonise ensuite les lignes séparément avec l’algorithme utilisé. On moyenne un ensemble de micros placés en différents points (non symétriques) de la salle. On harmonise ensuite les lignes ensemble. Enfin, on recorrige subjectivement sur des contenus musicaux.

En fait, pour la WFS, on n’a pas de point de référence. Il faut que ce soit le même réglage pour chaque enceinte et idéalement qu’elles soient espacées de la même distance. Tu peux te permettre d’avoir une distance inter acoustique qui ne soit pas la même entre chaque enceinte. Le souci c’est que tu vas fausser la spatialisation pour certaines zones.

Admettons que je rapproche les deux boîtes du centre, je serai plus précis sur les objets sonores qui vont être joués principalement au centre, en revanche je perds sur les côtés.

C’est comme un élastique… C’est pour ça que généralement, nous plaçons les enceintes de manière symétrique. Mais ça peut arriver que ce ne soit pas possible. Par exemple pour des contraintes de lumière ou de spectacle ou des systèmes de diffusion déjà installés. Dans ce cas, on s’adapte.

Madje Malki vient d’arriver. Avant les premières balances, nous abordons le sujet du son spatialisé et sommes bien entendu très curieux de connaître l’approche de l’un des ingénieurs du son les plus réputés et qui anime la scène française et internationale depuis de très nombreuses années.

SLU : Que penses-tu des systèmes de diffusion sonores spatialisés ?

Madje Malki : Je suis pour cette approche WFS ou autre. 10% du public seulement profite d’une écoute stéréo avec une diffusion gauche/droite, et le reste de l’audience ne perçoit qu’une source mono avec des problèmes de filtrage en peigne. Tu n’as pas tous ces inconvénients avec des systèmes spatialisés.

SLU : Et beaucoup d’enceintes comme ici pour de l’immersif, cela te parait efficace ?

Madje Malki : Le souci qu’on a avec un système WFS, c’est la quantité d’enceintes. Pour assurer une couverture optimale la longueur de la ligne WFS doit être au minimum égale à la largeur de la scène. On parle de son immersif, mais je préfère dire que nous avons une réelle écoute stéréo. C’est un travail de localisation des sources disposées sur scène, 70% du public peut les percevoir et les placer dans l’espace scénique. Terminée cette sommation au centre et les filtrages en peigne. C’est pour moi la chose la plus essentielle et je pense que c’est l’étape future.

SLU : C’est le système d’après ?

Madje Malki : Depuis le V-DOSC et les générations suivantes, nous disposons de bons systèmes gauche/droite, les moins interférents possible, avec des enceintes couplables. Maintenant nous disposons de nouveaux outils pour réaliser une belle image stéréo qui est spatialisée pour une plus grande partie du public. Le choix d’un système WFS est un procédé bien maîtrisé. C’est l’axiome de départ. Après les différents fabricants l’interprètent plus ou moins différemment.

La seule limitation de la WFS n’est pas le nombre d’haut-parleurs mais leur portée. Ici à La Scala, c’est une salle moyenne, on est obligé d’installer une grande quantité d’enceintes pour une couverture homogène. Ce qui est normal, puisque tu as une enceinte qui produit un champ unique non couplable, d’où la limitation de ce type d’implantation pour des grandes salles. En revanche, pour le champ proche, comme c’est le cas ici, c’est optimal. C’est étonnant dans les balcons, et à peu près partout dans la salle, même pour les premiers rangs.

SLU : Tu avais déjà fait du son spatialisé avec Renaud ?

Madje Malki : Oui j’avais fait la tournée de 2017 avec un système L-ISA, beaucoup mieux adapté aux grandes salles. Dans l’idée, au lieu de faire un gauche/droite où l’on joue la voix en puissance, je l’ai plutôt faite entourer par ses musiciens. Cela permet d’avoir une voix seule au centre, complètement isolée et non interférente, la plus cohérente possible et donc la plus naturelle possible. J’ai la même approche, ici avec l’HOLOPHONIX, ce qui me permet d’arriver à un résultat très musical. Une approche visuelle naturelle dans la spatialisation, la voix entourée de ses musiciens.

SLU : Tu es donc plutôt positif vis à vis de ces nouveaux systèmes ?

Madje Malki : Je pense que les algorithmes, la puissance des ordinateurs, des consoles sont là, mais il faut savoir prendre des risques et innover. Une nouvelle voie s’ouvre.

SLU : Pour gérer du surround ?

Madje Malki : Bien sûr. Avec ce type de système, tu peux commencer à ajouter des effets immersifs. En ce moment, je travaille beaucoup cet aspect-là. Dans Starmania, nous avons un design avec des effets surround. Ils doivent être hors tempo, pour fonctionner dans les grandes salles. Un système spatialisé permet d’obtenir une écoute stéréo et immersive avec le surround accessible à un grand nombre de spectateurs, et un son proche du cinéma.

SLU : Comment vois-tu le mix par objets?

Madje Malki : De mon point de vue, je ne fais pas un mix par objet mais un mix stéréo. La stéréo devient une image spatialisée qui permet de suivre un spectacle tout en étant immergé. C’est un travail un peu difficile. Pour du théâtre cela marche bien, dans un spectacle musical, à part des chorus à déplacer, ce n’est pas évident. J’envoie plusieurs groupes comme objets sonores.

Nous avons reproduit la scène physique de la manière la plus réaliste possible, pour que le public en champ proche ou éloigné la perçoive correctement. La WFS est impressionnante en champ très proche car la proximité avec l’artiste permet de garder parfaitement la localisation.

SLU : Cela change ton travail à la console?

Madje Malki : Ça exige un travail à la console plus créatif. C’est parfait pour les réverbes, mais si tu as fait un gros travail en dynamique, c’est un peu plus difficile à percevoir.

SLU : Perçois-tu une limitation ?

Madje Malki : Quel que soit le système spatialisé, je n’ai pas le même impact qu’un système traditionnel. Il y a donc un vrai travail à faire au niveau des enceintes, une autre architecture. Les enceintes doivent être compactes, puissantes, plus légères tout en considérant les hauteurs de lignes pour respecter la formation d’une onde cylindrique. Ici tout fonctionne bien parce que nous sommes dans une salle de petite taille.

SLU : Est-ce que la spatialisation favorise l’intelligibilité de la voix de Renaud ?

Madje Malki : L’important est de donner une forme à l’objet sonore. C’est ce que je fais sur la voix de Renaud. J’ai sa voix directe avec une première compression.

Je l’envoie sur différents groupes dans lesquels je rajoute les bons plugs pour gagner de l’intelligibilité, du grain, de la chaleur, et je dose l’ensemble.

SLU : Et dans l’immersif, tu utilises des réverbérations ?

Madje Malki : Je n’utilise pas les réverbes immersives intégrées au système spatialisé. C’est parfait pour le théâtre ou un orchestre un symphonique où il faut recréer une acoustique dans un lieu, mais pour de la musique moderne, cela vient plutôt en contradiction avec ta production sonore. J’envoie simplement mes réverbes.

Dans la salle de la Scala d’Avignon, je les avais envoyées en surround, ça fonctionnait très bien. Ici, notre surround est limité pour des raisons de ressources processing. On voit bien que les systèmes spatialisés sont très adaptatifs, et dans tous les cas ils apportent indéniablement toujours un plus.

SLU : Ici, c’est plutôt un moment particulier dans la tournée de Renaud ?

Madje Malki : Sur la tournée de Renaud, j’utilise les systèmes de sonorisation installées sur place. Quand tu pars dans cette démarche, ta sortie console doit être nickel. Renaud est mon premier artiste. C’est un peu émouvant de le retrouver là et le système de diffusion contribue à transmettre toutes ces émotions.

Pendant que les balances se poursuivent et en attendant le début du spectacle, nous rejoignons Alexis Beyer, directeur technique de La Scala qui lui aussi à son mot à dire sur le système de sonorisation spatialisé HOLOPHONIX.

SLU : Quelle perception as-tu de ce système de sonorisation spatialisé depuis son installation en 2017 ?

Alexis Beyer : Le système est super sur tous les points. Il n’y a aucun doute là-dessus. Après, son utilisation au réel impose une grosse session de formation du personnel technique. Nous avons en général deux spectacles quotidiens dans la grande salle et seulement 30 minutes de changement de plateau. Il n’y a donc pas de place pour l’aléatoire. Tout doit être cadré. Ici, sur un accueil aussi important que celui de Renaud, nous sommes heureux d’avoir l’intervention du fabricant Amadeus pour épauler notre équipe en interne.

SLU : La formation à cette nouvelle technique est donc nécessaire ?

Alexis Beyer : Oui, ce type de concert est une occasion idéale pour parfaire les niveaux de compétences de l’ensemble de nos équipes. L’éducation est aussi à faire au niveau des ingénieurs du son externes et bien sûr aussi des créateurs.

SLU : Vous avez une autre salle qui est plus dédiée à la résidence ?

Alexis Beyer : Oui, dans notre autre salle, La Scala Provence, un peu moins grande que celle-ci, nous avons le même système de diffusion sonore spatialisé en WFS avec un HOLOPHONIX. Dans cette salle, nous pouvons travailler davantage le son et les créations lors des résidences d’artistes. Nous faisons ainsi les premières des sorties de créations à Avignon, et après, nous transposons le son qui a été fait à Provence sur le système de Paris. C’est d’ailleurs ce qui s’est passé avec Renaud.

SLU : Le système est spatialisé depuis l’ouverture de la salle ?

Alexis Beyer : Oui, le système HOLOPHONIX a toujours été présent dans la salle de la Scala qui a ouvert en 2017. Au début, le système était exploité avec une diffusion à base de line array. Nous sommes passés en WFS il y a deux ans et nous avons rajouté la rampe au sol. Nous la retirons pour certains spectacles et nous la répartissons entre nos deux salles suivant les besoins artistiques respectifs. Nous faisons beaucoup de théâtre et certaines mises en scène imposent de l’enlever.

SLU : Comment faites-vous l’accueil des ingénieurs ?

Alexis Beyer : Je les informe tout de suite que notre salle est équipée d’un système spatialisé. Il y a beaucoup de techniciens qui sont réticents et il nous demandent juste un gauche/droite. Nous pouvons le faire sans problème si les délais de préparation sont trop courts ou si la production est frileuse, notre système HOLOPHONIX est paramétré pour ça. Cela dit, c’est notre travail et celui de notre régisseur de proposer d’utiliser pleinement le système immersif.

SLU : Vous ne faites pas du simple gauche/droite en réalité ?

Alexis Beyer : Non bien sûr. On triche un peu. On dit que c’est du gauche/droite mais nous avons toujours le système HOLOPHONIX qui gère la diffusion spatialisée pour maintenir grâce à la WFS une couverture sonore homogène et fidèle à la localisation sur l’ensemble de la salle.

SLU : Après ces années d’exploitation, quelles sont vos conclusions ?

Alexis Beyer : Nous sommes totalement satisfaits. Le système nous permet de gérer tous les types de spectacles et s’adapte parfaitement à leurs besoins de sonorisation, avec le temps dont nous disposons. Cette polyvalence et cette adaptabilité est parfaite pour nous et nous garantit un son en permanence optimisé. La spatialisation, c’est vraiment bluffant.

Entendre partout le même son dans notre salle qui est plutôt complexe en termes d’espaces et de volumes est un plus indéniable. Si je devais améliorer le système, j’aurais juste tendance à vouloir ajouter un peu plus de subwoofers.

SLU : Qu’en pense le public ?

Alexis Beyer : Il est ravi. Renaud a un public formidable avec une vraie attente et l’envie de partager un bon moment. Nous l’avons ressenti ici sur nos deux dates, et surtout sur le concert à Provence. Avec des artistes chargés d’émotion et un public très fidélisé comme c’est le cas ici, la qualité de notre système de diffusion participe beaucoup à créer des moments exceptionnels.

En musique classique, les spectateurs aiment être près de la scène pour voir les artistes. Le gradin d’orchestre se rétracte ce qui nous permet de faire de belles configurations de spectacles comme deux pianos au centre en bi-frontal avec le public autour. Le système HOLOPHONIX nous permet facilement d’adapter la diffusion à des formats particuliers, en offrant à tout le public un rendu équivalent.

SLU : Dans le futur ?

Alexis Beyer : Nous voyons bien que la Scala prend de l’importance par son système immersif. Il faut bien comprendre que ce système nous permet de faire un excellent renfort sonore pour les concerts acoustiques et nous en avons beaucoup de ce type. Nos productions musicales sont principalement dédiées à la musique classique et au piano. Elles partent aussi en tournée et nous les adaptons en fonction des systèmes de diffusion que nous rencontrons. Le futur, c’est de développer nos productions avec l’idée de pouvoir exploiter la spatialisation au maximum.

Nous nous apercevons une fois de plus que le système de sonorisation spatialisé permet de résoudre bien des problèmes acoustiques tout en améliorant le mixage traditionnel et l’expérience d’écoute du public. Il ouvre aussi la voie vers de nouveaux développements créatifs encore inexplorés. Le spectacle de Renaud en est une fois de plus un très bon exemple.

Avec son système HOLOPHONIX, La Scala a permis d’offrir une expérience inoubliable à un public qui recherche toujours la plus grande proximité possible avec un artiste qu’il adore. Entourée d’une subtile orchestration, la voix de Renaud, dans ce précieux écrin sonore, a ému chacun de ses admirateurs, comme s’il chantait tout proche de leur oreille et de leur cœur.

D’autres informations sur :